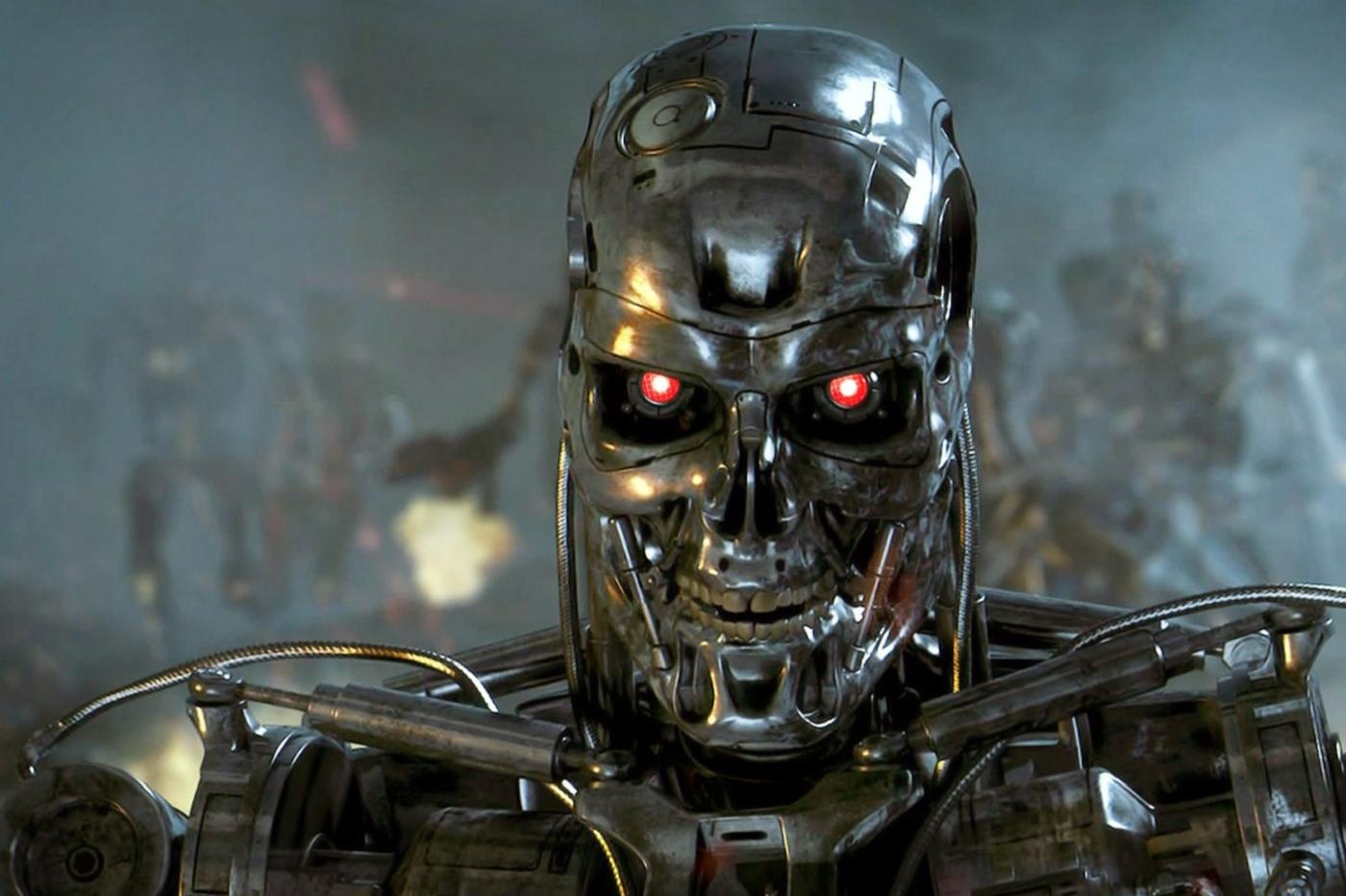

IA militaire: la Chine avertit sur les armes autonomes et Terminator La Chine avertit sur les armes autonomes et le débat sur l'IA militaire s'intensifie entre normes et risques. L'IA militaire est au cœur d'un débat qui mêle anxiété et enjeux stratégiques.

L'IA militaire est au cœur d'un débat qui mêle anxiété et enjeux stratégiques. Quand Pékin met en garde les États‑Unis sur la possibilité de laisser des algorithmes décider de la vie et de la mort sur le champ de bataille, on touche à un sujet qui dépasse le simple progrès technologique. Ce point s'inscrit dans une rivalité plus large autour des systèmes d'armes autonomes et dans le contexte d'un affrontement entre le Pentagone et des acteurs privés comme Anthropic autour de Claude pour des usages militaires.

La Chine appelle à encadrer l'IA militaire

La Chine a réaffirmé, par des déclarations officielles et lors de forums internationaux, qu'il faut encadrer l'IA utilisée sur les théâtres d'opérations. L'objectif affiché est un cadre global, assorti de mécanismes de responsabilité et d'obligations de transparence sur les systèmes d'armes autonomes. Pékin soutient l'idée que la vie et la mort sur le champ de bataille ne doivent pas dépendre d'un logiciel seul, mais d'un contrôle humain ou d'un cadre normatif robuste.

Ce que cela change dans le débat international

Ce contexte s'inscrit dans un débat global sur les armes autonomes. Aux États‑Unis, le dialogue entre les agences de défense et les développeurs privés s'accentue sur les garde-fous, les lignes rouges et les protocoles de vérification des systèmes avant leur déploiement. Anthropic a exprimé des positions prudentes sur l'usage militaire de Claude, soulignant la nécessité de restrictions et de tests approfondis pour éviter les dérives.

- Contrainte éthique : responsabilité clairement attribuée en cas d'erreur et de dommages.

- Course technologique : risque d'accélération sans accords cohérents sur l'utilisation et la supervision.

- Règles et vérifications : appels à la transparence et à des mécanismes de vérification des systèmes d'armes autonomes.

Les limites et incertitudes

Les limites techniques et éthiques ne manquent pas. Les systèmes d'armes autonomes dépendent de capteurs, de données et de l'intégration avec d'autres technologies, ce qui peut générer des erreurs coûteuses en conditions réelles. Les risques incluent la mauvaise identification des cibles, les biais dans les algorithmes et la tentation d'exploiter des failles par des adversaires. En outre, le droit international humanitaire et les règles de guerre restent en débat tant que les normes universelles font défaut et que les engagements réels manquent.

Pour terminer

Pour moi, ce débat est autant une question de gouvernance que de technologie. L'IA militaire transforme les hypothèses de sécurité, mais la question clé est comment encadrer ces technologies pour éviter le pire. La perspective d'une norme internationale, l'examen des notions de human-in-the-loop ou de human-on-the-loop, et la transparence des systèmes méritent une attention soutenue. À suivre : les annonces étatiques, les essais et les propositions des organisations internationales qui tentent d'apporter des garde-fous sans étouffer l'innovation.