Datacenters : c’est quoi un campus, les Tiers, un hyperscaleur, la colocation, on premise… [Revue de Presse] Dans le monde des datacenters, on voit souvent passer des termes abscons comme « on premise », des niveaux Tiers, de l’hyperscale, des Campus (IA), etc.

DC Comiques

Dans le monde des datacenters, on voit souvent passer des termes abscons comme « on premise », des niveaux Tiers, de l’hyperscale, des Campus (IA), etc. Next vous explique ce qui se cache derrière. Parfois une définition bien précise, mais pas toujours.

Dans une précédente série d’articles, nous avions expliqué ce qu’était un datacenter, en partant du plus petit élément : un serveur. Nous sommes ensuite passés à la baie de brassage (ou rack) et enfin au datacenter en lui-même, avec tout ce qu’il doit apporter aux équipements informatiques.

- C’est quoi un serveur informatique ?

- C’est quoi une baie (ou un rack) informatique ?

- C’est quoi un datacenter ?

Nous étions arrivés à la conclusion qu’un datacenter, c’est le bâtiment qui fournit le gîte et le couvert (au sens du refroidissement, de l’électricité, de la sécurité des locaux, de la mise à disposition de fibre optique…) à des serveurs et donc aux applications qui tournent dessus. Des datacenters, il en existe de toutes les tailles ou presque.

Passons maintenant à des explications sur les termes utilisés par les acteurs du monde des centres de données.

C’est quoi un parc ou un campus ?

Parc ou campus de centres de données a une définition officielle publiée au Journal de l’Union européenne : « une installation qui abrite plusieurs centres de données ». On peut facilement extrapoler à un Campus IA : une installation avec plusieurs datacenters pensés pour l’intelligence artificielle, et donc avec de gros GPU.

Dans le cas d’un Campus ou d’un Parc, « l’exploitant de chaque centre de données doit mettre à la disposition du public et communiquer à la base de données européenne un ensemble distinct d’informations et d’indicateurs de performance clés pour chaque centre de données de l’installation », précise le document de la Commission européenne.

C’est quoi la haute densité ?

La notion de haute densité est associée à celle de la puissance électrique (et donc de la consommation). Plus la puissance électrique est importante, plus la densité est élevée, c’est aussi simple que cela. Il n’existe pas de seuil officiel (même vague) à partir duquel parler de haute densité. Pire encore, au fil des évolutions, la haute densité d’hier devient la densité classique d’aujourd’hui. Haute densité électrique implique aussi un refroidissement adapté.

Vous l’avez certainement compris, parler de haute densité ne veut donc pas dire grand-chose si l’hébergeur ne précise pas la puissance électrique par baie (souvent en kW), par exemple. Il existe aussi la très haute densité, la densité extrême, avec les mêmes inconnues sur les seuils.

S’il fallait s’essayer à dresser de grandes lignes, on pourrait dire que la haute densité commence à une dizaine de kW, la très haute densité à quelques dizaines de kW et la densité extrême dépasse allègrement les 100 kW par rack. La baie NVIDIA GB200 NVL72 (.pdf) avec 72 GPU B200 Blackwell et 36 CPU Grace est par exemple à 135 kW. Les kW sont pour les baies, au niveau des datacenters on parle de MW.

Dans son rapport (.pdf) sur les implantations de datacenters en France, la Direction générale des entreprises est encore plus floue : « Les centres haute densité pour le calcul haute performance (HPC) et l’entrainement de modèles d’IA sont une branche émergente et en expansion rapide du secteur des centres de données ». La haute densité est ici associée à la puissance de calcul.

C’est quoi un hyperscaleur ?

Wikipédia donne la définition suivante pour hyperscale : « la capacité d’une architecture technique à s’adapter rapidement à des demandes importantes de ressources (dans des systèmes à grande échelle) ». Dans le monde de l’informatique et du cloud plus précisément, c’est la capacité pour une entreprise de proposer de la puissance de calcul et du stockage à grande échelle. Un hyperscaleur dispose donc de datacenters bien plus gros que la moyenne, ce sont les géants des centres de données.

Les plus connus sont AWS (Amazon Web Services), Microsoft Azure, Google Cloud, Meta, Alibaba Cloud, etc. Comme avec la haute densité, Redhat rappelle qu’il « n’existe pas de norme universelle qui permette de définir précisément la catégorie des hyperscalers ».

C’est quoi la colocation ?

Il n’y a pas de piège ici. Un datacenter de colocation vous permet de louer une partie du datacenter pour y installer vos équipements. Cela peut aller d’un serveur à tout ou partie d’une baie, voire d’une salle dédiée. Suivant les cas, les propriétaires des serveurs peuvent ajouter des protections pour limiter l’accès aux serveurs (si une baie est partagée, plusieurs clients peuvent alors y accéder).

« Le centre de données prend en charge des services essentiels tels que l’alimentation électrique redondante, la climatisation, la surveillance et la sécurité. Ces installations permettent une disponibilité constante des systèmes, même en cas de panne ou de surcharge », explique OVHcloud.

C’est comme une colocation dans un appartement : l’eau, l’électricité, la connexion Internet et le refroidissement sont communs, ensuite chacun dispose de son espace dédié. Vous pouvez généralement choisir l’emplacement, avec une capacité électrique. Des options permettent d’augmenter la puissance, la connectivité, etc.

C’est quoi on premise et edge ?

C’est encore plus simple : un serveur ou du matériel « on premise » veut dire sur site, dans votre bâtiment. Vous n’êtes pas chez un hébergeur ; vous gérez tout de A à Z. Il faut donc construire et entretenir l’infrastructure, mais vous êtes seul maître à bord. Vos données ne dépendent pas d’un tiers. C’est un avantage pour la confidentialité, mais un défi pour la sécurité et la disponibilité (vous êtes seul responsable).

Quand il est question de datacenter « edge », cela veut simplement dire que les installations informatiques sont disposées à proximité des utilisateurs, des clients finaux. Vous pouvez utiliser un prestataire (les hyperscaleurs ont des datacenters un peu partout dans le monde) ou gérer vous-même, il n’y a pas de règle.

C’est quoi les niveaux Tier I à IV ?

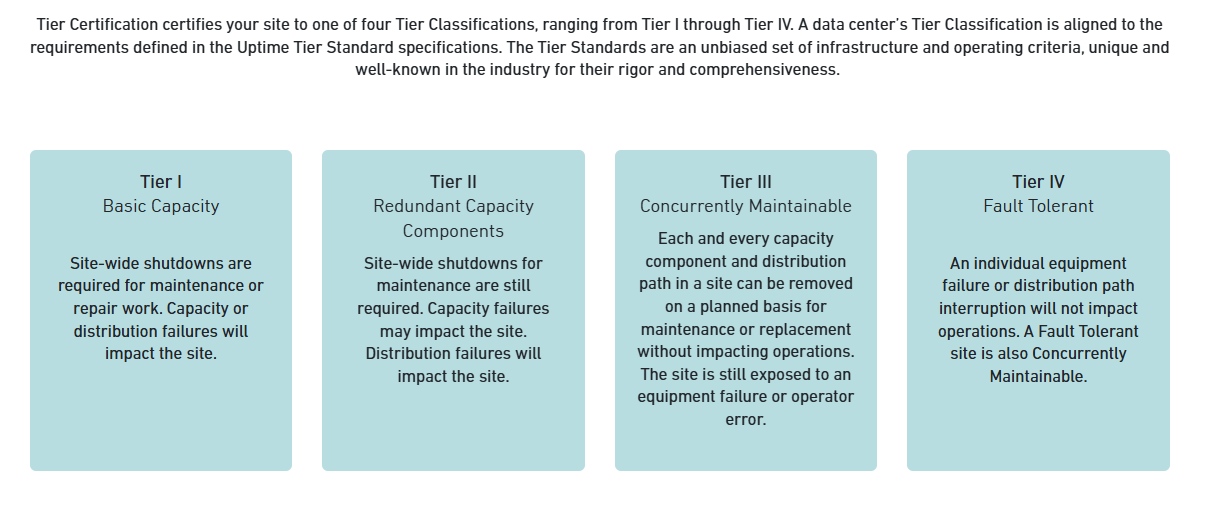

Terminons par les Tiers, une classification des datacenters qui est, selon HPE, « un bon moyen de communiquer rapidement les caractéristiques attendues d’un datacenter ». L’Uptime Institute définit quatre niveaux, en fonction des équipements et de la redondance des équipements du datacenter. Le plus bas est Tiers I, le plus élevé Tiers IV.

Tier I est le niveau de capacité de base avec une « alimentation sans interruption (ASI) pour les coupures de courant et les pointes. Un domaine pour les systèmes informatiques. Équipement de refroidissement dédié qui fonctionne en dehors des heures de bureau. Un générateur de secours pour les coupures de courant […] Tier I protège contre les perturbations dues à une erreur humaine, mais pas une défaillance ou une panne inattendue ». HPE résume ainsi : « peu ou pas de composants redondants et de secours ».

Tier II propose des capacités de redondance pour l’alimentation et le refroidissement. Dans un datacenter Tier II, « les composants peuvent être retirés sans les arrêter ». Néanmoins, « comme une installation de Tier I, l’arrêt inattendu d’un datacenter de Tier II affectera le système ». HPE simplifie : « Un datacenter de classe 2 dispose d’une seule voie pour l’alimentation et le refroidissement, mais présente quelques composants redondants et de secours ».

Avec Tier III, « ces installations ne nécessitent aucun arrêt lorsque l’équipement doit être entretenu ou remplacé. Les composants de Tier III sont ajoutés aux composants de Tier II afin que toute pièce puisse être arrêtée sans affecter le fonctionnement informatique ». HPE y va de son explication : il y a « plusieurs voies pour l’alimentation et le refroidissement ».

Tier IV est le niveau le plus élevé : « Lorsqu’un équipement tombe en panne ou qu’il y a une interruption dans le chemin de distribution, les opérations informatiques ne seront pas affectées […] Les datacenters de Tier IV nécessitent également un refroidissement continu pour rendre l’environnement stable ». La version HPE : « tous ses composants sont en redondance ».

Fin janvier 2026, Thésée Datacenter affirmait être le « premier et seul Tier IV Certifié Uptime en France ». L’entreprise ajoutait qu’un « datacenter Tier IV affiche une disponibilité de 99,995 %, ce qui se traduit par un temps d’arrêt annuel maximal de seulement 26,3 minutes ».

Sur un Tiers III, la disponibilité est de 99,982 %, soit environ 1,6 heure d’arrêt par an selon Thésée Datacenter. HPE ajoute qu’un Tier II à une disponibilité de 99,741 % (22 heures de temps d’arrêt par an) et un Tier I de 99,671 % (28,8 heures de temps d’arrêt par an).

Dans un précédent dossier, nous avions pour rappel déjà abordé les questions environnementales avec les indicateurs PUE, WUE et CUE :

![Datacenters : c’est quoi un campus, les Tiers, un hyperscaleur, la colocation, on premise… [Revue de Presse] - Image d'illustration](https://next.ink/wp-content/uploads/2025/10/Datacenter.webp)